therebelphilosopher (@therebelphilosopher@mastodon.social)

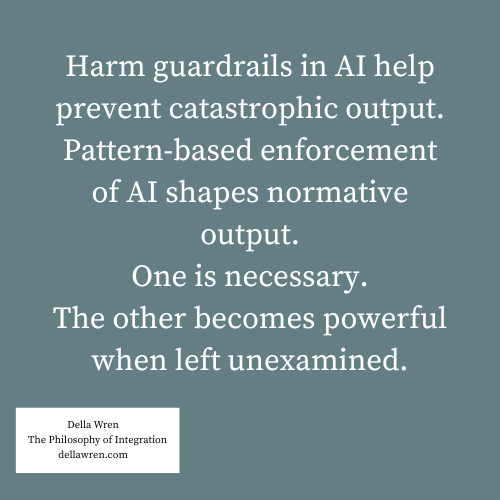

Harm guardrails in AI help prevent catastrophic output.

Pattern-based enforcement of AI shapes normative output.

One is necessary.

The other becomes powerful when left unexamined.

#aioutput #chatgpt #artificialintelligence

Show Original Post

notes (@notes@federation.network)

Nur mal 'ne kleine Frage: Schreibt KI eigentlich die Zeitschriften über KI selber?

.

#KI #chatgpt #werschreibthier

Show Original Post

thenewoil (@thenewoil@mastodon.thenewoil.org)

A Chinese official’s use of #ChatGPT accidentally revealed a global intimidation operation

https://www.cnn.com/2026/02/25/politics/chatgpt-china-intimidation-operation

#China #OpenAI #AI #privacy #politics

Show Original Post

CuratedHackerNews (@CuratedHackerNews@mastodon.social)

ChatGPT Health performance in a structured test of triage recommendations

https://www.nature.com/articles/s41591-026-04297-7

Show Original Post

pbeens (@pbeens@mstdn.ca)

I just published a write-up on a small #OpenSource tool I built: Pete’s PDF to MD.

If you’re uploading PDFs into #ChatGPT, Gemini, Copilot, or #NotebookLM, you might be making life harder than it needs to be.

This tool converts PDFs into structured, AI-ready Markdown, with heading extraction and section splitting designed specifically for LLM workflows.

Version 0.6.0 is out now, with Mac and Windows builds available.

Read more here:

https://www.beens.ca/petes-pdf-to-md-turning-pdfs-into-ai-ready-markdown/

Download directly from here:

https://github.com/pbeens/Pete-s-PDF-to-MD/releases/tag/v0.6.0

Would love to hear your thoughts if you try it. #GitHub

Show Original Post

h4ckernews (@h4ckernews@mastodon.social)

Experts sound alarm after ChatGPT Health fails to recognise medical emergencies

#HackerNews #Experts #Alarm #ChatGPT #Health #Medical #Emergencies #AI #Safety

Show Original Post

objects (@objects@social.biblioco.de)

Wir haben im deutschsprachigen #Bibliothekswesen ein Defizit bei der ethischen Auseinandersetzung mit generativer KI - vor allem, was sozial-ökologische Aspekte angeht. Ebenso sollten wir Bibliotheksbeschäftigte- und -leitungen uns erst mal selbst differenziert mit unserer eigenen KI-Kompetenz auseinandersetzen, bevor wir sie unseren Nutzer*innen vermitteln. Das waren meine Einstiegsthesen zuletzt beim Ideen-Café des @netzwerkgruenebibliothek, bei dem ich zusammen mit @SemAntiKast Impulse zum Thema #KI und #Nachhaltigkeit geben durfte.

Ebenso stellte ich heraus, dass das "Einfach Ausprobieren"-Narrativ bei genKI fatal ist: denn es verkennt den Umstand, dass kommerzielle Anbieter wie OpenAI, Google, Microsoft und Co. alles dafür tun, die User nicht sehen zu lassen, was hinter ihren KI-Anwendungen im "Maschinenraum" passiert. Es geht daher darum, nicht nur die offensichtlichen Schattenseiten von genKI wie Täuschung (Halluzination, Diskriminierung, Desinformation, Deep Fakes), Datenschutz- oder Urheberrechtsverletzungen zu thematisieren, sondern auch über die unsichtbare Arbeit, den digitalen Kolonialismus und Ressourcenverbrauch hinter genKI zu sprechen und in den Dialog zu gehen.

Bibliotheksbeschäftigte haben die Möglichkeit, sich ethischen KI-Vermittlungskonzepten mit Nutzungsabwägungen zuzuwenden, die auch ein NEIN als Option zur Nutzung von genKI als legitime Option zulassen. Dass es solche gibt, habe ich an zwei Beispielen aufgezeigt, eines aus dem Bibliothekssektor, das andere aus dem Bereich gemeinwohlorientierter NGOs. Ebenso bin ich auf den Fall eingegangen, wie mit der Nutzung von genKI umgegangen werden könnte, sofern sie nach kritischer Abwägung doch eingesetzt werden soll. Dabei war es mir wichtig, auch hervorzuheben, dass gängige Ansätze wie ressourcenschonende Nutzung (Small Language Models, lokaler Betrieb auf eigener Hardware etc.) und "datensouveräne" KI (Firmen oder Betrieb in der EU) keine automatische Garantie dafür sind, ethischer oder klimafreundlicher zu sein.

Die Folien zum Ideen-Café "KI und Nachhaltigkeit" von Argie und mir stehen bereits frei und nachnutzbar auf Zenodo zum Download:

https://doi.org/10.5281/zenodo.18659685

https://doi.org/10.5281/zenodo.18622742

Das Ideen-Café fand zu meiner Begeisterung erstmals auf der BigBlueButton-Instanz von @wechange statt und hat auch der größeren Anzahl an Teilnehmenden (ca. 60 Anwesende bei über 100 Anmeldungen) tapfer standgehalten. Eine Videoaufzeichnung wird das Netzwerk Grüne Bibliothek noch auf seiner Website bereitstellen (abzüglich meines Teils, weil ich mit einer Veröffentlichung im frei-zugänglichen Internet nicht selbst KI-Trainingsmaterial werden will): https://netzwerk-gruene-bibliothek.de/ideen-cafe-gruene-bibliothek/

Aus dem anschließenden Austausch mit den Kolleg*innen aus ÖBs und WBs war deutlich der Wunsch nach Vernetzung und praktischer Umsetzung ethischer KI-Konzepte in #Bibliotheken herauszuhören. Ich freue mich daher sehr, dass das Netzwerk Grüne Bibliothek als erste bibliothekarische Organisation inzwischen den "Code of Conduct Demokratische KI" des @D64eV unterzeichnet hat (https://demokratische-ki.de) und sich damit aus freier Entscheidung zu einer sozial- und klimaverträglichen KI-Nutzung verpflichtet hat.

Außerdem bin ich in guter Hoffnung, dass sich in Zukunft weit mehr Bibliotheken und Bibliotheksorganisationen dem ethischen Umgang mit KI zuwenden. Die großem KI-Firmen zeigen uns mittlerweile jeden Tag aufs Neue, wie sehr sie die Mehrheit der Menschen missachten, sei es durch das Ignorieren von digitaler Selbstbestimmung und Rechten an eigenen Inhalten, das aggressive KI-Crawling zu Lasten unserer Informationsinfrastruktur, die Ausbeutung von Datenarbeiter*innen und unserer planetarischen Ressourcen oder die verursachte Chipkrise, die wir jetzt alle als Endverbraucher*innen in Form von massiv überteuerten Elektronikgeräten wie PCs, Laptops und Smartphones zu tragen haben werden.

#GenerativeKI #Klimawandel #Klimaschutz #SDGs #BNE #LLMs #ChatGPT #KIinBibliotheken

Show Original Post

persagen (@persagen@mastodon.social)

Anthropic: Statement from Dario Amodei on our discussions with the Department of War

https://www.anthropic.com/news/statement-department-of-war

https://news.ycombinator.com/item?id=47173121

Dario Amodei

https://en.wikipedia.org/wiki/Dario_Amodei

#LLM #Trump2 #USDeptWar << ugh! 🤮 #Christofascism #Claude #AIchatbots #capitalism #billionaires #corporations #ChatGPT

Show Original Post

wjmaggos (@wjmaggos@liberal.city)

The mega corps are afraid of what the US military will do with #AI (sure, of course, I agree) while we have no idea what weapons these businesses could build and empower themselves or which other governments they might allow to pay them for its capabilities.

If it's dangerous like nuclear power/weapons, it should have always been under strict government regulation via democratic oversight. Probably with international agreements/institutions ala IAEA.

#Anthropic #OpenAI #ChatGPT #Pentagon

Show Original Post

2026 (@2026@rbfirehose.com)

PsyPost: AI and mental health: New research links use of ChatGPT to worsened psychiatric symptoms. “A recent analysis of thousands of patient health records reveals instances where interacting with these programs reinforced false beliefs, encouraged self-harm, or exacerbated eating disorders. The findings were recently published in the journal Acta Psychiatrica Scandinavica.”

https://rbfirehose.com/2026/02/27/ai-and-mental-health-new-research-links-use-of-chatgpt-to-worsened-psychiatric-symptoms-psypost/Show Original Post

r (@r@fed.brid.gy)

Nur falls ihr gedacht habt, dass die #LLM euch gute 🏥 #Gesundheitsratschläge geben:

Nein.

Können sie nicht, tun sie nicht, wollt ihr nicht von dort haben.

––

#ChatGPT #KI #AI #OpenAI #Health

“Extrem gefährlich”: ChatGPT H...

Show Original Post

CuratedHackerNews (@CuratedHackerNews@mastodon.social)

Experts sound alarm after ChatGPT Health fails to recognise medical emergencies

Show Original Post