posts (@posts@aisparkup.com)

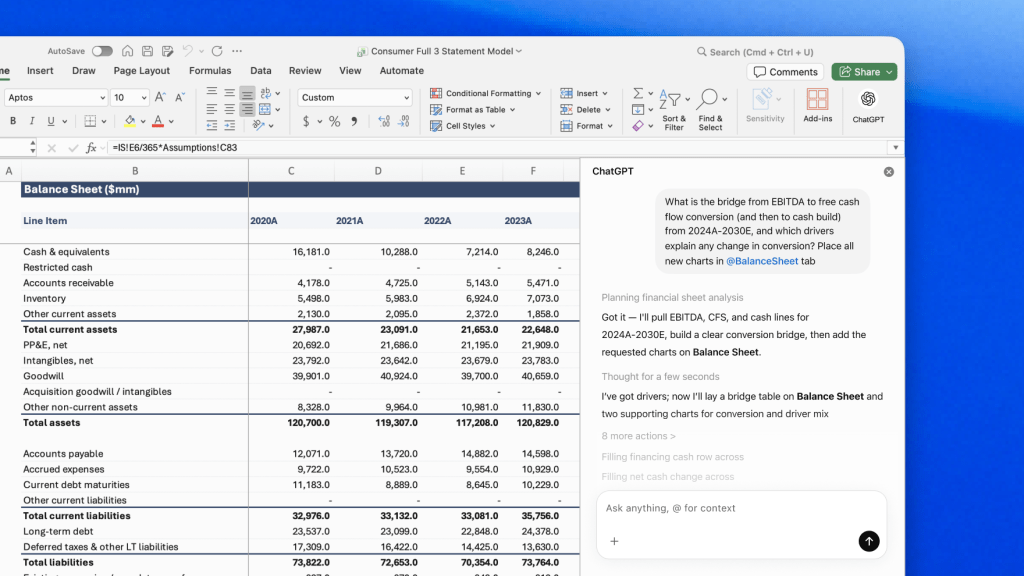

ChatGPT가 Excel에 들어왔다, AI 재무모델링 도구 4종 실전 비교

OpenAI가 GPT-5.4 기반 ChatGPT for Excel을 출시했습니다. Wall Street Prep의 독립 벤치마크로 본 AI 재무모델링 도구 4종의 실전 성능을 소개합니다.https://aisparkup.com/posts/10165

Show Original Post

r (@r@fed.brid.gy)

affordabletravelbookstorereadact.blogspot.com/2025/07/trav... #trumpscoverup #johnsonscoverup #chatgpt

Explore the intersection of tr...

Show Original Post

apple-shazam-chatgpt-identify-songs (@apple-shazam-chatgpt-identify-songs@gadgetbond.com)

Shazam in ChatGPT lets you identify songs while you chat

Once connected, Shazam can be summoned in ChatGPT using @Shazam or by starting your message with “Shazam.”https://gadgetbond.com/apple-shazam-chatgpt-identify-songs/

Show Original Post

feed (@feed@igeek.gamer-geek-news.com)

🤖 ChatGPT ads still exclusive to the United States, OpenAI says no to global rollout just yet

submitted by /u/Tiny-Independent273 [link] [comments]

📰 Source: Artificial Intelligence (AI)

🔗 Link: https://www.reddit.com/r/artificial/comments/1rv69kf/chatgpt_ads_still_exclusive_to_the_united_states/

#AI #ArtificialIntelligence #ChatGPT

Show Original Post

2026 (@2026@infosertecla.com)

Niños, niñas y chatbots – Riesgos principales a los que prestar atención

Los chatbots de inteligencia artificial trasformaron la cotidianidad de muchas personas hace casi tres años. ChatGPT, por ejemplo, dice tener unos 700 millones de usuarios activos semanales, muchos de los cuales son «jóvenes». Un estudio británico de julio de 2025 reveló que casi dos tercios (64%) de los niños utilizan este tipo de herramientas. A una proporción similar de adultos les preocupa que sus hijos piensen que los chatbots de IA son personas reales. En este contexto, ESET, acerca los riesgos principales a los que prestar atención cuando se habla de infancias y chatbots (Fuente ESET Latam).

“Están surgiendo preocupaciones legítimas en materia de seguridad, privacidad y psicología debido al uso frecuente de esta tecnología por parte de los más jóvenes. Como adultos responsables, no se puede dar por sentado que todos los proveedores de plataformas cuentan con medidas eficaces de seguridad y privacidad adecuadas para los infantes. Incluso cuando existen protecciones, su aplicación no es necesariamente coherente, y la propia tecnología evoluciona más rápido que las políticas.”, advierte Martina Lopez, Investigadora de Seguridad Informática de ESET Latinoamérica.

Niños y niñas utilizan la IA generativa (GenAI) de diversas maneras. Algunos valoran su ayuda para hacer los deberes. Otros pueden tratar al chatbot como a un compañero digital, pidiéndole consejo y confiando en sus respuestas como lo harían con un amigo íntimo. Esto, según ESET, conlleva varios riesgos evidentes.

El primero es psicológico y social. Los niños atraviesan un periodo de desarrollo emocional y cognitivo, lo que les hace vulnerables en varios sentidos. Pueden llegar a confiar en la IA como una compañía en detrimento de la formación de amistades genuinas con sus compañeros de clase, lo que exacerba el aislamiento social. Como los chatbots están preprogramados para complacer a sus usuarios, pueden producir resultados que amplifiquen las dificultades por las que puedan estar pasando los jóvenes, como trastornos alimentarios, autolesiones o pensamientos intrusivos. También existe el riesgo de que el menor pase tiempo con su inteligencia artificial, no sólo en detrimento de las amistades humanas, sino también del tiempo que debería dedicar a hacer los deberes o a estar con la familia.

También hay riesgos en torno a lo que un chatbot GenAI puede permitir que un menor acceda en internet. Aunque los principales proveedores tienen barras de contención diseñadas para limitar los enlaces a contenidos inapropiados o peligrosos, no siempre son eficaces. En algunos casos, pueden anular estas medidas de seguridad internas para compartir contenidos sexualmente explícitos o violentos, por ejemplo. Si tu hijo tiene más conocimientos de tecnología, puede incluso ser capaz de «jailbreak» el sistema a través de indicaciones específicas.

La información errónea son otro motivo de preocupación. Para los usuarios corporativos, esto puede crear importantes riesgos de reputación y responsabilidad. Pero para los niños, puede dar lugar a que crean información falsa presentada de forma convincente como un hecho, lo que los lleva a tomar decisiones imprudentes sobre cuestiones médicas o de pareja.

Por último, es importante recordar que los chatbots también suponen un riesgo potencial para la privacidad. Si un niño introduce información personal y financiera sensible en una consulta, el proveedor la almacenará. Si eso ocurre, en teoría podría acceder a ella un tercero (por ejemplo, un proveedor/socio), o ser pirateada por un ciberdelincuente. Del mismo modo que no se querría que un niño compartiera demasiado en las redes sociales, lo mejor es minimizar lo que comparte con un bot GenAI.

Dependiendo de dónde vivan y de qué chatbot estén utilizando, puede que haya poca verificación de edad o moderación de contenidos. Por lo tanto, es responsabilidad de los adultos anticiparse a cualquier amenaza mediante una supervisión y educación proactivas.

ESET comparte algunas señales de que un niño o niña puede tener una relación poco saludable con la IA:

- Se retiran del tiempo extraescolar que pasan con amigos y familiares

- Se ponen nerviosos cuando no pueden acceder a su chatbot e intentan ocultar los signos de uso excesivo

- Hablan del chatbot como si fuera una persona real

- Repiten como «hechos» información errónea obvia

- Preguntan a su IA sobre enfermedades graves, como problemas de salud mental (que puedes averiguar accediendo al historial de conversaciones)

- Acceden a contenidos para adultos o inapropiados ofrecidos por la IA

“En muchas jurisdicciones, los chatbots de IA están restringidos a usuarios mayores de 13 años. Sin embargo, dada la irregularidad o complejidad en su aplicación, es posible que se tenga que tomar cartas en el asunto. Las conversaciones importan más que los controles por sí solos. Para obtener los mejores resultados, consideremos la posibilidad de combinar los controles técnicos con la educación, el asesoramiento y sobre todo el acompañamiento, impartidos de forma abierta y sin confrontación.”, comenta Luis Lubeck, vocero de Argentina Cibersegura.

Tanto si están en la escuela, en casa o en un club extraescolar, los menores tienen adultos que los guían en lo que tienen que hacer. Por eso, desde ESET recomiendan intentar que la comunicación sobre la IA sea un diálogo bidireccional, en el que se sientan cómodos compartiendo sus experiencias sin miedo a ser castigados. Explicarles los peligros del uso excesivo, el intercambio de datos y la dependencia excesiva de la IA para resolver problemas graves. Ayudarles a entender que los robots de IA no son personas reales sino máquinas diseñadas para ser atractivas. Enseñarles a pensar de forma crítica y chequear siempre los resultados de la IA. Además de nunca sustituir una charla con sus padres por una sesión con una máquina.

Si es necesario, se aconseja combinar esa parte educativa con una política para limitar el uso de la IA (igual que se limitaría el uso de las redes sociales o el tiempo de pantalla en general) y restringir su uso a plataformas apropiadas para su edad. Activar el control parental en las aplicaciones que utilicen para ayudarle a supervisar su uso y minimizar los riesgos. Recordarles que nunca deben compartir información personal identificable (IPI) con la IA y ajustar su configuración de privacidad para reducir el riesgo de filtraciones involuntarias.

“Los más pequeños necesitan seres humanos en el centro de su mundo emocional. La IA puede ser una herramienta útil para muchas cosas. Pero hasta que los niños desarrollen una relación sana con ella, su uso debe supervisarse cuidadosamente. Y nunca debe sustituir al contacto humano”, concluye Lopez de ESET.

Para conocer más sobre el cuidado de los niños en Internet, puede visitar Digipadres, una iniciativa impulsada por SaferKidsOnline de ESET, que busca acompañar a madres, padres y docentes con el fin de generar conciencia acerca de riesgos y amenazas en el mundo digital. Se brindan materiales para el proceso de aprendizaje, diálogo y supervisión con el objetivo de facilitar los conocimientos necesarios para ayudar a lo más pequeños en el uso de las nuevas tecnologías. Para más información sobre los peligros que enfrentan los niños en línea, visite: https://digipadres.com/

#arielmcorg #chatgpt #eset #genai #IA #infosertec #PORTADA #privacidadEnNiños

Show Original Post

eighthave (@eighthave@social.librem.one)

#Technology can empower people, the key is what it empowers people to do. #Weapons technology allows people to kill others ever more effectively. And #AI #ChatBot #tech like #ChatGPT can empower us to make our deepest darkest fantasies real. Most of the world has decided that it is not a net positive for individuals to have easy access to deadly weapons. Although chatbots can do useful things, it seems ever clearer that lots of the uses of #LLMs do more harm than good

https://techcrunch.com/2026/03/15/lawyer-behind-ai-psychosis-cases-warns-of-mass-casualty-risks/

Show Original Post

r (@r@fed.brid.gy)

bsky.app/starter-pack... Mauritius: A Unique Travel and Tourism Destination - With Blue Sky Starter Information Packs for Civic Empowerment Curated by Llewelyn Pritchard 18 July 2025 #PersonalExperience #AiEvidentialMaterials #ChatGPT #PersonalExperience

RE: https://bsky.brid.gy/convert/ap/at://did:plc:4sivhpo2an6off6obxrbc3oo/app.bsky.graph.starterpack/3luau5usexh25

Show Original Post

numerama (@numerama@news.piaf.im)

Condamné par un cancer, son chien survit grâce à un vaccin conçu avec ChatGPT

#IntelligenceArtificielle #Tech #Australie #Chatgpt

Condamné par les vétérinaires à voir sa chienne mourir d’un cancer avancé, un ingénieur australien a décidé de concevoir lui-même un traitement expérimental. En s’aidant notamment de ChatGPT et d’out-->

https://www.numerama.com/tech/2210171-condamne-par-un-cancer-son-chien-survit-grace-a-un-vaccin-concu-avec-chatgpt.html

Mon, 16 Mar 2026 10:36:15 +0000

Show Original Post

r (@r@fed.brid.gy)

quislingborisjohnson.blogspot.com/2025/07/maur... #PersonalExperience #AiEvidentialMaterials #ChatGPT #Mauritiustravelguide #sustainabletourism #BlueSkyinfopacks

Mauritius: A Unique Travel and...

Show Original Post

r (@r@fed.brid.gy)

www.tumblr.com/climatejusti... #PersonalExperience #AiEvidentialMaterials #ChatGPT NOTE ‘It is crucial to exercise critical rationality and verify AI-generated reports.

Post by @climatejustice1 · 1 l...

Show Original Post

r (@r@fed.brid.gy)

quislingborisjohnson.blogspot.com/2025/07/clim... #BlueskyStarterPacks #climatejustice #sustainablefuture

#grassrootsclimatesolutions #humanrights #ai #climatejustice

#corruption #education #civilresistance #rightsofnature

#perplexity #trumpscoverup #johnsonscoverup #chatgpt

#artificialintelligence

CLIMATE CRISIS SOLUTIONS from ...

Show Original Post

us (@us@newsbeep.org)

You will soon be able to talk extensively about your Garmin health data with an AI

Garmin smartwatch users may soon have a new way to understand their health and fitness data, simply by…

#NewsBeep #News #US #USA #UnitedStates #UnitedStatesOfAmerica #Artificialintelligence #AI #ArtificialIntelligence #ChatGPT #Claude #Garmin #Technology #wearables

https://www.newsbeep.com/us/526593/

Show Original Post